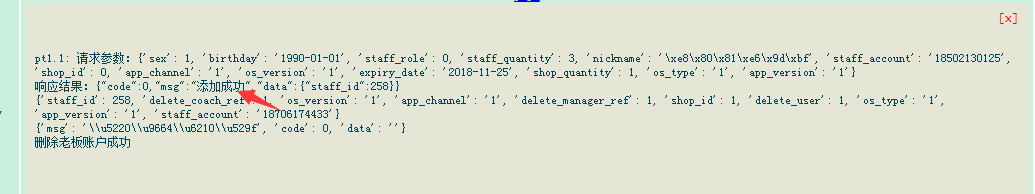

print ("响应结果:%:s" % r.content.decode('unicode_escape'))

一、

爬虫经常需要抓取网页信息"\u4eba\u751f\u82e6\u77ed\uff0cpy\u662f\u5cb8"转化为中文,其实这是unicode中文编码。可以用以下方法转换:

1、

1 >>> s = u'\u4eba\u751f\u82e6\u77ed\uff0cpy\u662f\u5cb8'

2 >>> print s

3 人生苦短,py是岸

2、

1 >>> s = r'\u4eba\u751f\u82e6\u77ed\uff0cpy\u662f\u5cb8'

2 >>> s = s.decode('unicode_escape')

3 >>> print s

4 人生苦短,py是岸

二、

另外,在python2字符编码问题经常遇到UnicodeEncodeError: 'ascii' codec can't encode characters in position 0-5: ordinal not in range编码错误(128)。

通常可以解决以下方法:

1 import sys

2 reload(sys)

3 sys.setdefaultencoding('utf-8')

此方法是将Python2的默认编码ASCII改为 utf-8.但这种方法不是一劳永逸的,可能会使一些代码的行为变得奇怪。

可参考此连接:http://blog.ernest.me/post/python-setdefaultencoding-unicode-bytes