苹果最近正式推出了新款iPad Pro,吸引了很多人的注意。官方口号中有一句话特别引人注目,它的Pro级摄像头开启了真实与虚拟的交界处。

新款iPad Pro搭载的Pro级摄像头不仅包括全新的超广角摄像头,还包括激光雷达扫描仪。扫描仪使用dToF结合运动传感器和技术iPadOS内部结构,可以进行深度测量,限可能地开启增强现实和更广泛的领域。

那么dToF是什么?它和我们以前在市场上已经存在的一样iToF有什么区别?

本文将会介绍dToF和iToF对比分析成像原理dToF和iToF两者的区别,带领大家了解一下ToF领域。

首先,让我们先来了解一下ToF基本概念。

Time-of-Flight(ToF),顾名思义,它是一种利用光飞时间的技术。接触过3D视觉读者应该知道,ToF和结构光、双目立体视觉是近年来三大主流D成像方式。ToF近红外光发射到场景中,用光的飞行时间信息测量场景中物体的距离。ToF比较另外两种3D成像方式,深度信息计算量小,抗干扰性强,测量范围远。促进了各种优势ToF应用于机器人、交互等工业领域。特别是在移动端,华为、OPPO、苹果,用于手机后置摄像头。

了解了ToF在概念之后,让我们深入了解这两类ToF文章标题中提到的基本成像原理iToF和dToF。

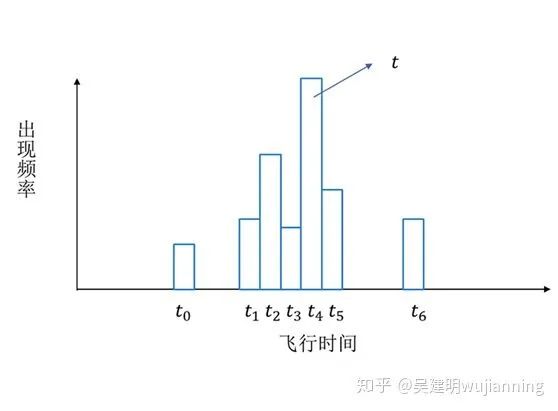

dToF,全称是direct Time-of-Flight。顾名思义,dToF飞行时间直接测量。dToF包括核心组件VCSEL、单光子雪崩二极管SPAD和时间数字转换器TDC。Single Photon Avalanche Diode(SPAD)它是一种具有单光子探测能力的光电探测雪崩二极管,只要有微弱的光信号就能产生电流。dToF模组的VCSEL脉冲波发射到场景中,SPAD接收从目标物体反射的脉冲波。Time Digital Converter(TDC)能记录每次接收到的光信号的飞行时间,即发射脉冲和接收脉冲之间的时间间隔。dToFN次光信号将在单帧测量时间内发射和接收,然后直接计算记录的N次飞行时间,最频繁的飞行时间t用于计算待测物体的深度。

图1是dToF单像素点记录的光飞行时间直方图,其中高度最高的柱对应的时间是像素点的最终光飞行时间。

dToF虽然原理看起来很简单,但实际上很难达到更高的精度。脉冲信号的精度除了对时钟同步有很高的精度要求外,还有很高的要求。普通光电二极管很难满足这种需求。而dToF核心组件SPAD由于生产工艺复杂,能胜任生产任务的厂家不多,集成困难。所以目前的研究dToF厂家不多,更多的是在研究和推广iToF。

iToF的概念和dToF对应,全称是indirect Time-of-Flight,直译是间接光飞行时间。间接是指iToF通过测量相位偏移间接测量光的飞行时间,而不是直接测量光的飞行时间。

iToF将准备好的红外光信号发送到场景中,然后通过传感器接收场景中待测对象反射的光信号,计算发射信号与接收信号之间的相位差,以获得目标对象的深度。如图2所示。

图2. iToF[1]iToF包括模块的核心组件VCSEL图像传感器。VCSEL调制红外光发射特定频率。图像传感器在曝光时间内接收反射光并进行光电转换。曝光(积分)后,读取数据,通过模拟数字转换器传输到计算单元,最后计算单元计算每个像素的相位偏移。iToF计算深度的方法通常是4-sampling-bucket算法使用4个相位延迟为0°,90°,180°和270°采样信号计算深度。如图3所示

图3. 连续波调法测相位移原理示意图[2]

dToF和iToF虽然采用光飞行时间技术,但两者在测距原理和硬件实现上存在差异。软硬件的差异会导致这两种类型ToF性能各方面各有千秋。

衡量ToF性能指标需要考虑几个方面。因为ToF作为一种测距设备,基本的评价指标是测距精度和有效的测距距离。其次,图像分辨率也是相机的重要评价指标。此外,由于ToF本身只能提供3D未来信息的发展将集成到3D比如3D建模、AR移动平台。集成到其他3D在相关应用中,特别是移动终端和机器人平台,必须考虑其能耗和成本,以及在各种复杂场景下的抗干扰能力。这些特征决定了dToF和iToF各有适用的应用场景。

接下来,本文会从精度、有效探测距离、图像分辨率、能耗、成本、抗干扰等7个方面,对比iToF和dToF的优劣。

精度

总的来说,目前的iToF深度精度在 cm 等级,随着测量距离的增加,反射光的强度降低,相位测量的信噪比降低,绝对误差也会增加。

距离的有效检测

有效检测距离是指相机能够输出可靠深度的距离范围,这意味着深度值与真实值之间的误差小于一定阈值。假设测量误差为2cm在内部,我们认为深度值是可靠的。如果一个ToF当模块测量5米物体时,测量值为5米.02米,误差刚刚达到预定义的极限。当物体位于5.01米时,测量值为5.22米,误差超出了2cm。我们可以说是的ToF模块的有效探测距离为5米。

当然,限制ToF相位模糊是有效探测距离的主要因素之一。

对于dToF就测量距离而言,当测量距离较远时,光来回飞行时间超过两个连续发射脉冲的间隔。传感器在发射第二个测量信号后接收第一个测量信号的反射波,将反射波误认为是第二个测量信号的近距离反射波,然后相位模糊。如图4所示。图4中case1表示在近距离场景下dToF测距原理图,case2表示的是远距离场景下,发生相位模糊现象的测距原理图。

§ dToF受测量频率(相邻两次测量间隔时间)的限制,iToF调制光的频率限制了有效的探测距离。dToF在测量远距离物体时,可以适当增加两次测量之间的间隔,减少测量次数。但是,减少测量次数会同时降低测量精度,相当于用精度换取有效的探测距离。而iToF为了获得更有效的探测距离,还可以降低调制光的频率。对于iToF双频可以用来解决相位模糊。使用两个不同频率的测量数据来解决相位模糊度,从而恢复正确的深度值。高精度测量和高有效的探测距离可以同时实现。能耗

从发射信号的角度来看, dToF则采用 脉冲激光等级,iToF目前大多采用连续波调制。相比之下,脉冲波可以达到超低空比,因此功耗也较低。

从光照模式的角度来看,因为dToF测量精度不会随着测量距离的增加而降低,因此功耗会相对较低。iToF目前大多采用面光发射。而且,随着测量距离的增加,iToF为了获得更高的精度,需要提高光照功率或延长曝光时间,所需的功耗也会大大增加。

成本

dToF采用无模数转换的数字电路架构。iToF模拟电路结构需要模数转换芯片。

对于整体硬件架构,dToF的核心组件SPAD生产工艺复杂,现有资源少。iToF这方面没有顾虑。

在系统集成方面, dToF系统集成还需要额外的时间来处理电路。iToF该系统易于集成,无需额外的测量电路。

抗环境干扰

环境干扰包括环境光干扰、多路径反射光干扰和不同表面灰度。这种环境干扰发生在外部和ToF环境干扰系不大,环境干扰的差异主要是不同的ToF由于测距原理。

dToF获取单帧深度图时,会反复测量,飞行时间会通过时间直方图统计来计算,更容易区分信号中的干扰成分。抗环境干扰能力更强。

iToF在曝光阶段,一些环境光混合在调制光中,被传感器接收,然后计算相位偏移。环境光引起的干扰无法从单个测量结果中区分。环境光越强,相应的深度误差越大。

应用场景

dToF功耗低,体积小,更适合工业机器人等需要快速测距避障检测的应用,以及空间有限的其他紧凑型设计。

dToF抗环境干扰性能较好,目前室外场景测距精度比较好iToF更高,在户外应用场景中也占主导地位。

dToF时间分辨率高,测量距离增大时精度不会大大降低,能耗也不会大大提高。AR应用中的优势也很明显。

iToF在物体识别中,图像分辨率高,3D在机器人、新零售等应用领域,重建和行为分析等应用场景可以重现场景中的更多细节。

dToF和iToF两者的目标是输出高质量的深度图像,因此都需要深度数据层的滤波和噪声校正,如空域滤波、点云域的噪声滤波和不一致像素校准。此外,两者都有透镜成像系统,所以无论如何dToF还是iToF,都需要透镜失真补偿。硬件温度变化带来的噪声也存在于两种情况下ToF因此,温度补偿也是两者所必需的。

dToF它是脉冲波的发射,而不是特定频率的调制波dToF与调制光频率无关,包括频率校准、自动频率选择、高动态范围(HDR)。但是dToF发射脉冲也有一定的频率,即相邻两个发射脉冲之间的时间间隔,dToF频率校准与发射脉冲的频率有关。dToF只输出深度图iToF因此,同时输出深度图和幅值图dToF不需要校准幅值。

此外,由场景干扰引起的多径、相位模糊、运动模糊和内反射都是两者的共同问题,尽管dToF由于成像原理具有较好的抗环境干扰能力,但仍会受到这种场景干扰的影响。但不同的是,因为dToF和iToF成像原理不同,两者所需的深度修正方法也不同。

dToF和iToF由于距离测量原理和硬件架构的不同,各方面的性能相互优缺点,应用场景也不同。两者都面临着场景的适应性。如何在任何场景中获得可靠和准确的深度数据都是一个巨大的技术挑战ToF技术及的关键。ToF应用技术的普及有赖于3D ISP增强引擎来消除干扰,降低功耗,提高实时性能;需要面向3D行业的ISP IP及中间件,有力支撑上层应用。所以说3D ISP是3D成像市场爆发的必要条件。数迹智能团队正在研发3D ToF ISP Smart3D-ISP,以ISP技术为核心系统性地提升无论是dToF还是iToF的性能并降低功耗和成本是多年来的研发目标,将我们的3D ToF技术植入每部手机、每辆汽车、每个机器人、每台家电,从而改变机器对世界的“看法”,实现深度的智能。

参考文献

[1] Foix S , Alenya G , Torras C . Lock-in Time-of-Flight (ToF) Cameras: A Survey[J]. IEEE Sensors Journal, 2011, 11(9):1917-1926.[2] L. Li, Time-of-Flight Camera—An Introduction, Texas Instruments-Technical White Paper.[3] John Kvam (2017), Time of Flight: Principles, Challenges, and Performance [pdf file].

来源:知乎,作者:吴建明wujianming,编辑:新机器视觉

本文仅做学术分享,如有侵权,请联系删文。

1.面向自动驾驶领域的多传感器数据融合技术

2.面向自动驾驶领域的3D点云目标检测全栈学习路线!(单模态+多模态/数据+代码)3.彻底搞透视觉三维重建:原理剖析、代码讲解、及优化改进4.国内首个面向工业级实战的点云处理课程5.激光-视觉-IMU-GPS融合SLAM算法梳理和代码讲解6.彻底搞懂视觉-惯性SLAM:基于VINS-Fusion正式开课啦7.彻底搞懂基于LOAM框架的3D激光SLAM: 源码剖析到算法优化8.彻底剖析室内、室外激光SLAM关键算法原理、代码和实战(cartographer+LOAM +LIO-SAM)

9.从零搭建一套结构光3D重建系统[理论+源码+实践]

10.单目深度估计方法:算法梳理与代码实现

11.自动驾驶中的深度学习模型部署实战

12.相机模型与标定(单目+双目+鱼眼)

13.重磅!四旋翼飞行器:算法与实战

14.ROS2从入门到精通:理论与实战

15.国内首个3D缺陷检测教程:理论、源码与实战

扫码添加小助手微信,可

一定要备注:

▲长按加微信群或投稿

▲长按关注公众号

学习3D视觉核心技术,扫描查看介绍,3天内无条件退款

圈里有高质量教程资料、答疑解惑、助你高效解决问题