在paper with code这篇文章是在上面发现的GitHub上搜索lidar camera calibration也是高star量仓库,先看他的文章。 原文链接. 简洁概要: 雷达作为相机,有点类似于双目标,雷达作为相机振幅作为雷达坐标系,但除了相机坐标系到图像坐标系的映射,在本文中使用雷达点云 L 1 L_1 L1范数方法估计雷达坐标系下的顶点坐标(先定义4个顶点求解点云到雷达变换,将求得的点云到雷达的变换求逆代入定义的顶点获得真正的顶点),注意看II.B方法是获取点云与雷达之间的变换关系,获取雷达坐标系的顶点坐标,获取图像角点后使用PnP或本文提出的IoU该方法用于获得两个传感器的外参变换关系RMS定量评价。目标与文章中的点云一致。

摘要

对于像SLAM激光雷达和单目相机之间说,激光雷达和单目相机之间的刚体变换非常重要。当雷达图像投影在相机图像上时,旋转变换的几度偏差或者百分之几的平移变换误差可能导致在5米测距情况下近20cm投影误差。确定准确变换关系的最大障碍实际上来自雷达点云的相对稀疏性和雷达测量时的系统误差。本文提出了(1)利用已知的尺寸和几何形状来改善目标的位置估计,以应对目标雷达图像的内部量化和系统误差。(2)一种拟合方法来解决雷达与单目相机的转换关系,从而避免了从点云中提取目标边界的繁琐任务。(3)并基于投影三维雷达的目标顶点进行交叉验证实验。显示和最终结果baseline与投影误差相比,方差减少了50%,方差减少了70%。

I. 介绍及相关工作

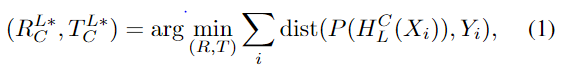

假设两个传感器的内参已经校准,只关注雷达和相机的刚性变换,如旋转矩阵和平移变换。之前的文献依据是否需要分为两类。基于目标的方法已经很好地实现了。主要问题是引入过多的人工操作,如仔细测量目标的不同部分、边界点和边缘点的配对检查。我们的方法避免了这些手动步骤,适用于各种平面多边形目标。 在基于目标的方法中,人们试图在雷达点云和相机图像平面中估计一组相应的目标特征点(如边界线、法向量、顶点)。如果特征足够独立,则可以通过n点透视法进行更改(PnP)求解,即通过优化这个公式的问题  X i X_i Xi (齐次)坐标具有雷达特征, Y i Y_i Yi是相机特征的坐标, P P P常被称为投影映射, H L C H^C_L HLC是用旋转矩阵 R L C R^C_L RLC和平移矩阵 T L C T^C_L TLC表示的从雷达幅面到相机幅面的其次变换矩阵,以及 d i s t dist dist是一个距离或测量误差。

X i X_i Xi (齐次)坐标具有雷达特征, Y i Y_i Yi是相机特征的坐标, P P P常被称为投影映射, H L C H^C_L HLC是用旋转矩阵 R L C R^C_L RLC和平移矩阵 T L C T^C_L TLC表示的从雷达幅面到相机幅面的其次变换矩阵,以及 d i s t dist dist是一个距离或测量误差。

A. 基于目标标定方法的概述

在标定是应将正方形目标旋转,使其呈现为一个钻石,可以帮助消除由于环形线的间距造成的不确定性。 如果平行放置,上下边界线将与雷达环形线平行,将会丢失很多点不利于边界的确定 两类常用的特征几何(a)矩形或三角形平面目标顶点的3D坐标,(b)目标平面的法向量和目标平面顶点连线。数学上这两组数据是等价的:知道其中一组可以确定另一组。在实际使用中,使用(b)将利用SVD来寻找法向量,更广泛地用于最小二乘线拟合问题,而(a)打开了其他视角。

图2a显示了工厂校准的32束Velodyne ULTRA Puck激光雷达在菱形平面目标上的25次扫描的3D视图。图2b显示了一些环校准很差,其“噪音水平”比制造商的规格高三倍。 平均而言,这些环接近LiDAR的规格(在小于50 m时±5 cm),这意味着同一环上的点之间最大相差10厘米。距离(或深度)测量中的系统误差会影响目标质心(通常用于确定目标相对于激光雷达的平移)和目标法向量(用于定义目标平面)的估计如图2c显示。随后,将点云正交投影到此平面,并通过执行RANSAC在适当的一组环边缘找到目标的线边界如图2d。沿着目标边界的线,然后定义它在平面上的顶点,我们将在后面指出,这些顶点不受目标几何形状的约束。

一旦确定了目标平面中的顶点,就可以知道目标的法线向量,从而将这些顶点提回点云的坐标。 这个过程可以通过对单个目标进行多次重复扫描,整合一个目标或多个目标的多次扫描,从而得出目标顶点的列表 { X i } i = 1 4 n {\{X_i\}}^{4n}_{i=1} { Xi}i=14n,从而得出目标姿态的数量。

目标通常设计为在相机图像中很容易辨认的顶点。 { Y i } i = 1 4 n {\{Y_i\}}^{4n}_{i=1} { Yi}i=14n表示在相机平面中对应的坐标,公式(1)中的概念拟合问题即可实现。尽管要最小化这个代价函数是一个非线性且非凸优化问题,但这通常不是一个问题因为CAD数据可以为局部求解提供一个恰当的初始猜测值,例如LM(Levenberg-Marquardt)算法。

B. 我们的贡献

(a)介绍了一种新方法来估计目标到雷达的刚体变换, H T L H^L_T HTL。通过当前的变换估计将点云投回雷达帧的原点,其代价函数定义为一个点到已知的雷达幅面中的几何的3D参考点的距离总和,对于落在参考目标之外的点为0。我们用 L 1 L_1 L1-inspired范数定义距离。与引文[23]一致,我们发现其对界外点敏感效果不如 L 2 L_2 L2-line用RANSAC拟合的边界点。 指的是l1,l2范数吗,横杠后是什么意思

(b)当估计顶点时通过使用整个目标点云避免识别边界点并将其解析成目标单个边缘的重复工作,其中一些边缘上的少量点因为雷达点云的稀疏性增强了量化效应。 没看懂

(c)我们做了循环验证实验,以将我们的方法与SOTA(最先进)的方法进行比较。我们验证实验的一个新特点是用相机图像作为真值替代;在3D语义映射上下文中,这很明显。除了用标准的PnP方法求解刚性变换,我们还研究了利用最大交并比(IoU)的方法进行估计。我们的算法在多种目标上进行了验证。 我个人认为就是引用了一些深度学习的概念来处理问题,像素作为真值其实不是他们最先提出的《CalibNet: Geometrically Supervised Extrinsic Calibration using 3D Spatial Transformer Networks》就是这么作几何约束的

(d)提供了开源代码,对应的开源代码地址。

II. 找出雷达目标顶点

我们假设每个目标都是平面的,正方形的,并且在LiDAR的框架中旋转了大约45°,从而在图2a中形成菱形。 如引文[23],[24]提到的,如果使LiDAR的环平行于目标边缘延伸,由于环的间距将导致竖直方向上的模糊。 我们假设已使用标准方法自动分离出目标的点云[27],该课题组研发的LidarTag技术,本文不赘述。 我们把四个顶点作为目标特征点,用 { X i } i = 1 4 {\{X_i\}}^{4}_{i=1} { Xi}i=14表示在雷达幅面的坐标;当使用时,我们没有注意区别普通坐标和其次坐标而是滥用了表示法。顶点 { X i } i = 1 4 {\{X_i\}}^{4}_{i=1} { Xi}i=14在点云中无法直接观察到。本节将用类似L1范数的新方法估计这些顶点在雷达幅面的坐标。 也许这就是 L 1 L_1 L1-inspired norm方法

A. 雷达点云上的标记

在图2c中,沿着z轴方向雷达有稠密的区域也有稀疏的区域。对于32线的elodyne UltraPuck,我们估计其z轴相对分辨率在稠密区 0.33 ° 0.33\degree 0.33°,在稀疏区 1.36 ° 1.36\degree 1.36°。一个点的沿y轴的距离分辨率大概 0.1 ° 0.1\degree 0.1°。在d米远的点,其量化误差大概为 d s i n θ dsin\theta dsinθ。所以如果目标特别远那么量化误差就会很大。图3a展示每个轴偏差 1 ° 1\degree 1°,平移变换偏差5%将会导致校正效果急剧下降。正如引文[23][24]提到的应该选择正确的角度放置目标利用已知的几何关系减小y轴,z轴的量化误差。

B. 确定目标顶点的新方法

用PC表示目标的雷达点云, χ i \chi_i χi表示3D点,雷达点云可以表示为 ,N表示目标点的个数。 我们需要得到雷达幅面的目标顶点,如图4,让 H L T H^T_L HLT表示从雷达帧中的参考目标顶点 { X i ˉ } i = 1 4 \{\bar{X_i}\}^4_{i=1} { Xiˉ}i=14变换到点云上。我们用反变换 H T L : = ( H L T ) − 1 H^L_T:=(H^T_L)^{-1} HTL:=(HLT)−1表示目标点云到雷达原点的变换,并在雷达原点出测量误差。

定义了一个c函数,对于 a ≥ 0 a\geq0 a≥0, λ ∈ R \lambda \in R λ∈R 引文[23]中称为“软 L 1 L_1 L1范数”。让 { χ ~ i } i = 1 N : = H T L ( P C ) : = { H T L ( χ i ) } i = 1 N \{\widetilde \chi_i\}^N_{i=1}:=H^L_T(PC):=\{H^L_T(\chi_i)\}^N_{i = 1} { χ i}i=1N:=HTL(PC):={ HTL(χi)}i=1N表示用 H T L H^L_T HTL从点云映射回雷达,用 ( x ~ i , y ~ i , z ~ i ) (\widetilde x_i,\widetilde y_i,\widetilde z_i) (x i,y i,z i)表示一个点的笛卡尔坐标。代价函数可以定义为 d是(正方形)目标尺寸,唯一的可优化参数 ϵ > 0 \epsilon >0 ϵ>0,代表理想目标的厚度。 ϵ \epsilon ϵ的值基于目标投影点的标准偏差,可以反应深度测量时的误差水平,如图2f。 我们提出了用旋转矩阵 R T L R^L_T RTL和平移向量 T T L T^L_T TTL确定最优刚体变换的方法,通过 并且定义估计的目标顶点通过下式获得 .需要强调的是,确定目标顶点时不用提取边缘点和分配关系到目标一侧。 此时不需要估计的顶点与目标的顶部,底部和左侧或右侧的物理对应关系。 (3)式中的代价函数是针对立方体的。明确地说,我们寻求的是在激光雷达幅面中对目标顶点的最佳估计,而不是变换本身。我们的方法时间接的,我们估计一个最好的雷达到目标的变换关系 H L T ∗ H^{T^*}_L HLT∗,并且用(5)式来定义顶点。

III. 图像平面的角点和雷达顶点的对应点

对于给定的雷达目标相机图像,用 { C Y i } i = 1 4 \{_CY_i\}^4_{i=1} { CYi}i=14表示相机图像中的角点。我们假设已经获得这些点,这些点将用在我们的方法和baseline方法中。这部分在标定问题中是比较简繁的,为了获得简单对应关系 X i ⟷ c Y i X_i\longleftrightarrow_cY_i Xi⟷cYi,顶点 { X i } i = 1 4 \{X_i\}^4_{i=1} { Xi}i=14顺序可能需要排列;我们用竖直水平位置进行排列。 一旦我们有了对应点,下一步就是把雷达目标投影到图像坐标中,关系式为 (6)式包含了相机内参矩阵和外参矩阵。 为了后续的使用,我们把(6)(7)定义一个雷达坐标到图像坐标的映射关系 注意这里的函数包含外参变量也包括雷达顶点坐标。

IV. 外部变换关系的优化

本节假设已经通过雷达帧的目标顶点与相机图像平面的对应关系已经确定,这个外部变化可以当作是一个标准的PnP问题:最小化对应角点的欧几里得距离。我们还提出了利用映射的多边形获得最大交并比方